Небезпека відеопідробок примусила Пентагон активно діяти

- Подробиці

- Опубліковано 30.06.2018 09:49

-

Автор: Конфликты и законы Конфлікти і закони

- Переглядів: 7772

Фейкові відео мають настільки високий потенціал з дестабілізації, що агенція новітніх розробок Міноборони США DARPA ухвалила рішення провести конкурс, основним завданням якого буде визначення найефективніших методів розпізнавання «діпфейків», або ж «глибоких фейків» (deepfake - прим. ГА) - відеопідробок, які зроблені настільки реалістично, що можуть викликати політичний скандал, чи навіть стати причиною конфлікту. Про це повідомляє агенція новин McClatchy, передає «Голос Америки».

У липні 10 команд винахідників із провідних американських університетів та Європи протягом 2-х тижнів змагатимуться у конкурсі на розробку технологій, які дозволять відрізнити фальшиві відео від реальних.

«Фейкові відео, які іноді називають deepfakes, створюються з використанням штучного інтелекту, можуть створити враження, що певна особа перебувала в якомусь місці, де вона не була, або робила заяви, яких насправді не було. З розвитком, фейкові відео можуть викликати потрясіння, як на особистому рівні, так і на рівні держав, і навіть викликати релігійні конфлікти», - наводить думку експертів видання.

«Швидкість прогресу вражає, - заявив виданню Джефф Клюне, експерт з «діпфейків». - Зараз вони мають пристойну якість, але незабаром стануть вражаючими».

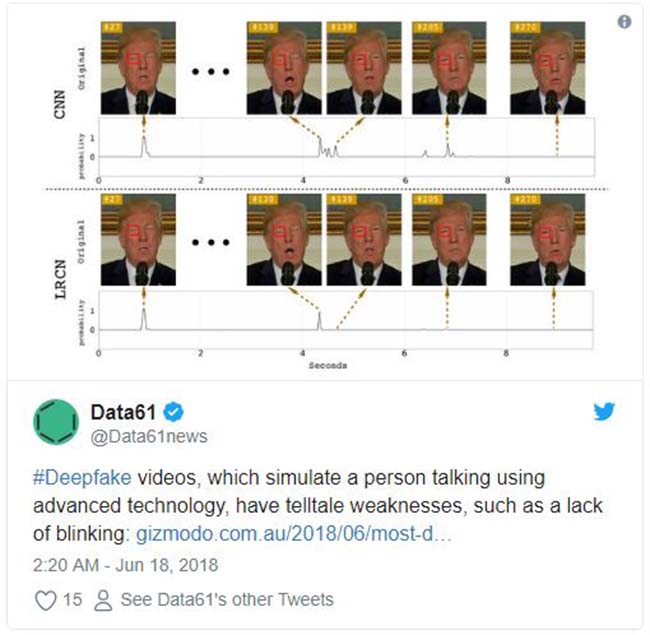

Наприклад, зараз підробки можна досить легко відрізнити за відсутністю блимання очей на картинці. На це звертають увагу на Data 61 CSIRO.

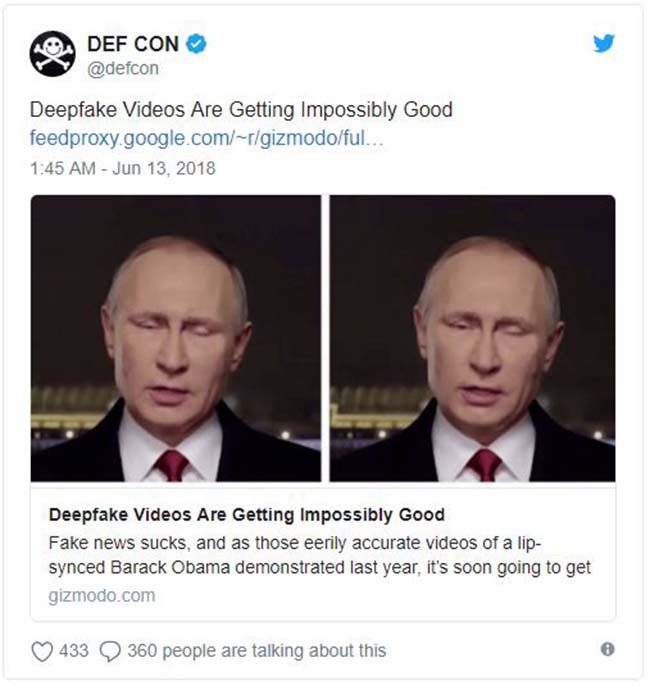

«Діпефейки стають неймовірно якісними», - писало у червні технологічне видання Gizmodo.

Фейкові відео вже набувають поширення. Минулого місяця Фламандська соціалістична партія поширила фейкове відео звернення президента США Трампа до мешканців Бельгії.

Фейкові аудіозаписи, наприклад, створюються за допомогою збору годин записів розмови реальної особи і подальшого реміксування фонем. Якість таких підробок покращується, але їх все ще досить легко розрізнити.

«Зараз вони звучать неприродньо. Але протягом 5 років аудіозаписи вже будуть здатні надурити слідчих; фейкові відео також прогресують», - розповів виданню Ґрегорі Аллен, експерт аналітичного центру Center for a New American Security з питань штучного інтелекту.

Деякі експерти твердять, що часова рамка для вдосконалення фальшивих відео навіть менша і що вже зараз творці фальшивих відео мають перевагу над дослідниками, які викривають фейки.

Конкурс, організований DARPA, є частиною 4-річної програми Аналізу Медіа, яка покликана створити інструменти визначення наявності відеоманіпуляцій та надання деталей щодо того, як було створено підробку. У змаганні беруть участь команди університетів Dartmouth, Notre Dame та Stanford Research Institute.

Нагадаємо, в Україні deepfakes вже не раз мали місце, наприклад, в обвинуваченнях проти нардепа Ігоря Мосійчука та екс-губернатора Одещини Михайла Саакашвілі.

Фото Reuters

Також з цієї категорії...

Набираючі популярність...

Останні новини

10.06.2026 09:28

Збито та подавлено 181 ворожий БпЛА10.06.2026 09:21

1190 москалів подохло минулої доби на українській земліВійськовий експерт Роман Світан в інтерв'ю Євгенії Кутновій заявив про критичну ситуацію в Костянтинівці

Коментарі